Một làn sóng phản đối mới đang nhắm vào YouTube, khi hơn 200 tổ chức và chuyên gia trong lĩnh vực bảo vệ trẻ em đồng loạt ký tên vào một bức thư ngỏ, kêu gọi nền tảng này mạnh tay xử lý nội dung do AI tạo ra trên YouTube Kids.

Bức thư do tổ chức vận động Fairplay khởi xướng và gửi trực tiếp đến CEO YouTube Neal Mohan cùng CEO Google Sundar Pichai vào đầu tháng 4. Danh sách ký tên bao gồm hàng loạt tổ chức giáo dục uy tín như Liên đoàn Giáo viên Mỹ, Hiệp hội Tư vấn Mỹ, cùng nhiều học giả, trong đó có Jonathan Haidt – tác giả cuốn The Anxious Generation.

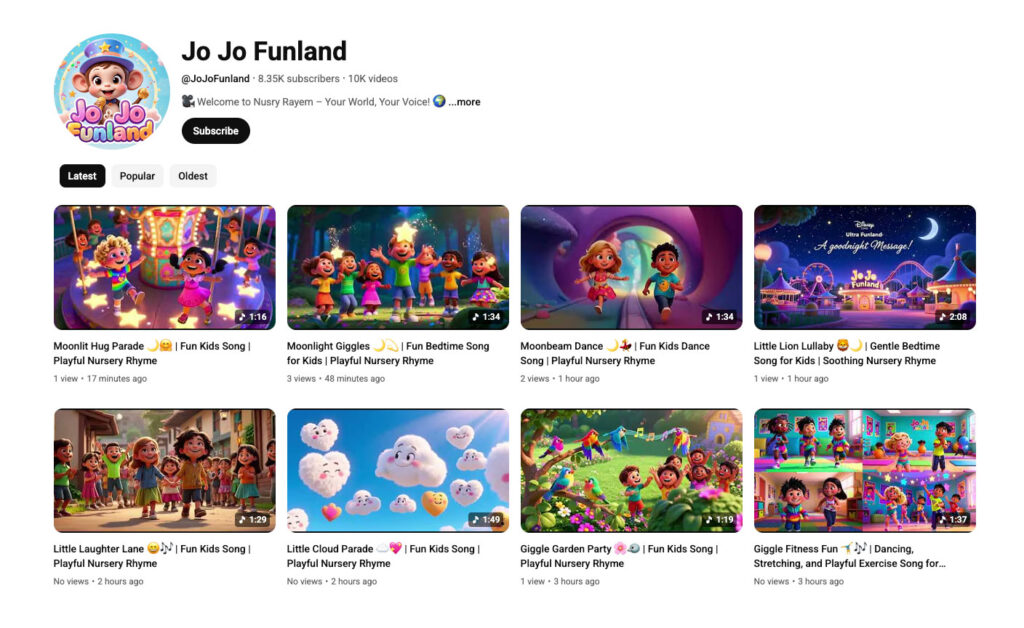

“AI Slop” – Nội dung rẻ, nhanh và tràn lan

Trọng tâm của bức thư là lời kêu gọi cấm hoàn toàn các video “AI Slop” khỏi YouTube Kids. Đây là thuật ngữ dùng để chỉ những nội dung được sản xuất hàng loạt bằng trí tuệ nhân tạo, thường có chất lượng thấp, thiếu chiều sâu và được tối ưu để giữ chân người xem hơn là mang lại giá trị thực sự.

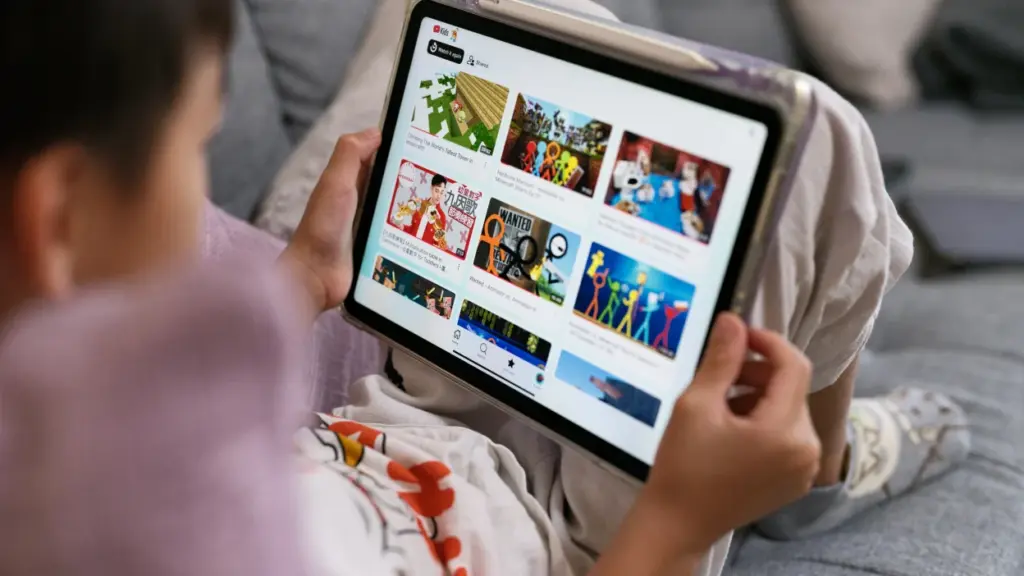

Theo Fairplay, các video dạng này không chỉ vô nghĩa mà còn tiềm ẩn nguy cơ ảnh hưởng đến sự phát triển nhận thức của trẻ nhỏ – trong khi cơ chế kiểm soát hiện tại của nền tảng vẫn chưa theo kịp tốc độ lan rộng của chúng.

Rachel Franz, Giám đốc chương trình Young Children Thrive Offline thuộc Fairplay, nhận định với Fortune: “Sự bùng nổ của video AI trên YouTube Kids là bước leo thang của những vấn đề mà nền tảng này đã gặp phải từ trước. Đây không chỉ là câu chuyện về AI, mà còn liên quan đến cách YouTube thiết kế hệ thống để giữ chân người dùng.”

Khi thuật toán tiếp tay cho nội dung kém chất lượng

Sự phát triển nhanh chóng của các công cụ AI đã khiến việc tạo video trở nên dễ dàng hơn bao giờ hết. Kết hợp với thuật toán lan truyền của TikTok, Instagram Reels hay YouTube Shorts, những nội dung dạng này có thể nhanh chóng đạt hàng triệu lượt xem.

Vấn đề nằm ở chỗ: phần lớn các video được tạo ra một cách vội vàng, thiếu kiểm chứng, đôi khi mang tính kỳ quặc hoặc phi logic – nhưng lại được thiết kế để thu hút tối đa sự chú ý của trẻ em.

Một báo cáo từ New York Times hồi tháng 2 cũng chỉ ra rằng “AI Slop” đã xuất hiện dày đặc trên YouTube Kids – nền tảng vốn được quảng bá là môi trường an toàn và chọn lọc dành cho trẻ.

Franz cảnh báo: “Những nội dung này thường bóp méo thực tế, gây nhầm lẫn và tác động đến cách trẻ hiểu về thế giới xung quanh. Và vấn đề là trẻ gần như không thể tránh khỏi việc tiếp xúc với chúng.”

Động cơ lợi nhuận đằng sau nội dung AI

Theo Fairplay, sự lan rộng của “AI Slop” không phải là ngẫu nhiên. Một số kênh chuyên sản xuất nội dung AI dành cho trẻ em hiện có thể kiếm hơn 4,25 triệu USD mỗi năm.

Thậm chí, có những người sáng tạo công khai chia sẻ cách kiếm tiền từ các video không cốt truyện, được sản xuất hàng loạt chỉ để tối đa hóa lượt xem.

Franz cho biết thêm: “Chỉ khoảng 5% nội dung dành cho trẻ dưới 8 tuổi trên YouTube có thể xem là chất lượng. Và ngay cả con số này cũng còn gây tranh cãi.”

Fairplay đề xuất hàng loạt biện pháp mạnh

Trong bức thư, Fairplay đưa ra nhiều đề xuất cụ thể:

- Gắn nhãn rõ ràng tất cả nội dung do AI tạo ra

- Cấm hoàn toàn video AI trên YouTube Kids

- Không cho phép nội dung AI “dành cho trẻ em” trên nền tảng chính

- Ngừng đề xuất video AI cho người dùng dưới 18 tuổi

- Cung cấp tùy chọn để phụ huynh tắt nội dung AI

- Dừng đầu tư vào nội dung trẻ em được tạo bởi AI

Franz nhấn mạnh: “Thuật toán hiện tại khiến trẻ không thể tránh khỏi nội dung rác. YouTube cần chấm dứt việc ‘đẩy’ những video này đến trẻ em trước khi hậu quả trở nên nghiêm trọng hơn.”

YouTube phản hồi: Đã có kiểm soát nhưng chưa rõ lộ trình

Trước những chỉ trích, YouTube phủ nhận một số số liệu trong thư. Đại diện công ty cho biết YouTube Kids vẫn duy trì “tiêu chuẩn cao”, bao gồm: giới hạn nội dung AI, gắn nhãn minh bạch và cung cấp công cụ kiểm soát cho phụ huynh. Nền tảng cũng đang phát triển thêm các giải pháp kiểm duyệt, nhưng chưa công bố thời gian cụ thể.

Ra mắt từ năm 2015, YouTube Kids từng được kỳ vọng là không gian an toàn cho trẻ em với hệ thống lọc nội dung và kiểm duyệt kết hợp giữa AI và con người. Tuy nhiên, nền tảng này liên tục đối mặt với tranh cãi khi để lọt các video “ngụy trang” không phù hợp.

Sự xuất hiện của nội dung AI chỉ khiến vấn đề trở nên phức tạp hơn.

Và lần này, câu hỏi không còn là “có nên kiểm soát hay không”, mà là: YouTube sẽ kiểm soát nhanh đến mức nào trước khi nội dung AI vượt khỏi tầm kiểm soát hoàn toàn?

Để lại đánh giá